Stable Diffusion ist ein leistungsstarkes KI-basiertes Bildgenerierungstool, das die kreative Welt im Sturm erobert hat. In diesem umfassenden Leitfaden werden wir uns mit den Feinheiten befassen Stable Diffusion, seine Funktionsprinzipien, seine Entwicklungsgeschichte und wie es sich von anderen KI-Zeichenanwendungen unterscheidet.

das Verständnis der Stable Diffusion Modell

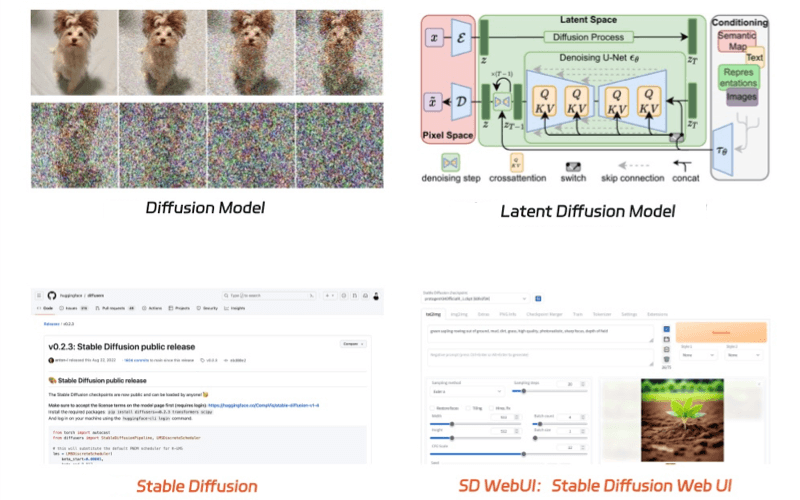

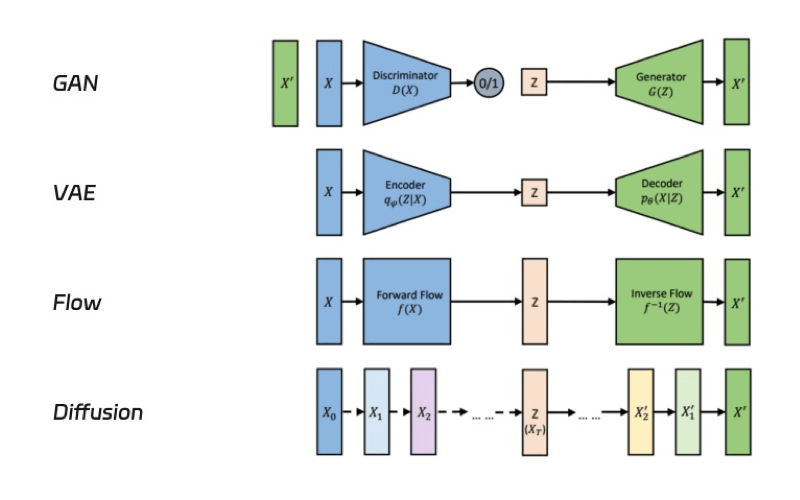

Im Herzen von Stable Diffusion ist das Diffusionsmodell, ein generatives Modell, das häufig bei der Bilderzeugung verwendet wird. Dieses Modell funktioniert, indem es den Trainingsbildern nach und nach Rauschen hinzufügt, bis sie zu reinem Rauschen werden, und dann den Prozess umkehrt, um neue Bilder zu erzeugen. Das Latent Diffusion Model, eine erweiterte Version des Diffusionsmodells, arbeitet in einem niedrigerdimensionalen Raum, reduziert den Rechenaufwand und beschleunigt die Bilderzeugung.

- Diffusionsmodell: Das Diffusionsmodell ist ein algorithmischer Rahmen, der Bilder aus Textbeschreibungen generieren kann. Mainstream-KI-Zeichenwerkzeuge wie DALL·E, Midjourneyund Stable Diffusion werden alle auf der Grundlage dieses Grundmodells entwickelt.

- Latentes Diffusionsmodell: Dies ist eine erweiterte Version des Diffusionsmodells, die entwickelt wurde, um Bildgrafiken schneller und mit geringerem Bedarf an Rechenressourcen und Speicher zu erstellen.

- Stable Diffusion: Dieses Modell wird allgemein als SD abgekürzt und basiert auf dem oben erwähnten latenten Diffusionsmodell. Es ist nach seinem Entwicklungsunternehmen Stability AI benannt, das im Wesentlichen als Branding dient.

- Stable Diffusion Webbenutzeroberfläche: Kurz für Stable Diffusion Bei der Web-Benutzeroberfläche handelt es sich um eine webbasierte Plattform, die für den Betrieb der oben genannten Funktionen entwickelt wurde Stable Diffusion Modell. Über diese Schnittstelle können Benutzer das Modell steuern, um Bilder zu generieren, ohne dass sie Programmierkenntnisse erlernen müssen.

Navigieren im Stable Diffusion Ökosystem

Um die Kraft von voll auszuschöpfen Stable Diffusion, ist es wichtig, seine Schlüsselkomponenten zu verstehen:

- ClipText-Textkodierer: Diese Komponente ist dafür verantwortlich, die von Ihnen bereitgestellten Textaufforderungen zu analysieren und sie in Funktionen zu übersetzen, die der Bildgenerator interpretieren und als Blaupause für die Bilderstellung verwenden kann.

- Diffusionsmodell: Das neuronale U-Net-Netzwerk und der Scheduler-Abtastalgorithmus arbeiten zusammen, um Bilder aus dem Rauschen zu generieren, wobei das U-Net die Merkmalsextraktion übernimmt und der Scheduler den Entrauschungsprozess vorgibt.

- VAE-Modell: Der Variational Auto Encoder dient als Decoder und hat die Aufgabe, die komprimierten Daten aus dem Latentraum zurück in ein hochauflösendes Bild umzuwandeln.

So generieren Sie ein KI-Bild mit Stable Diffusion

Nachdem Sie also die Grundlagen verstanden haben Stable DiffusionIch denke, Sie würden gerne wissen, wie Sie damit ein einzigartiges KI-Bild erstellen können. Und egal, ob Sie ein erfahrener Künstler oder ein unerfahrener Entdecker sind, dieser Leitfaden führt Sie durch den Prozess der Erstellung von KI-Bildern mit Stable Diffusion.

Schritt 1: Zugriff Stable Diffusion

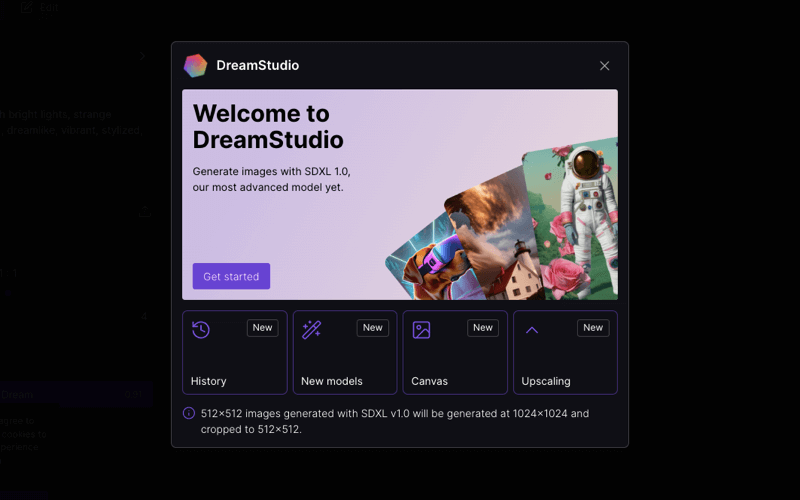

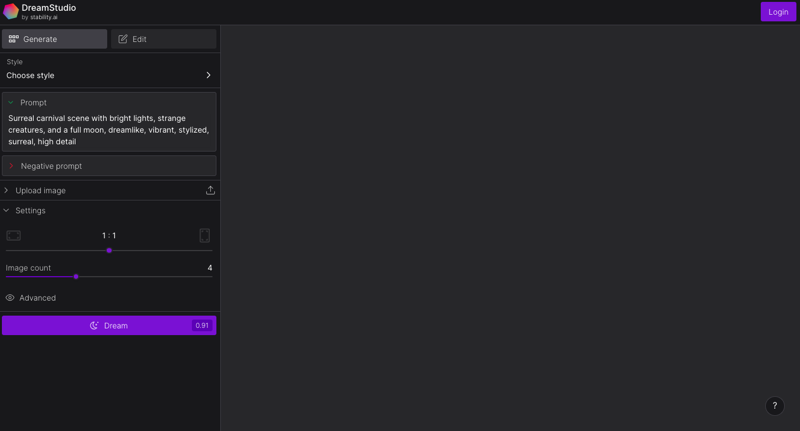

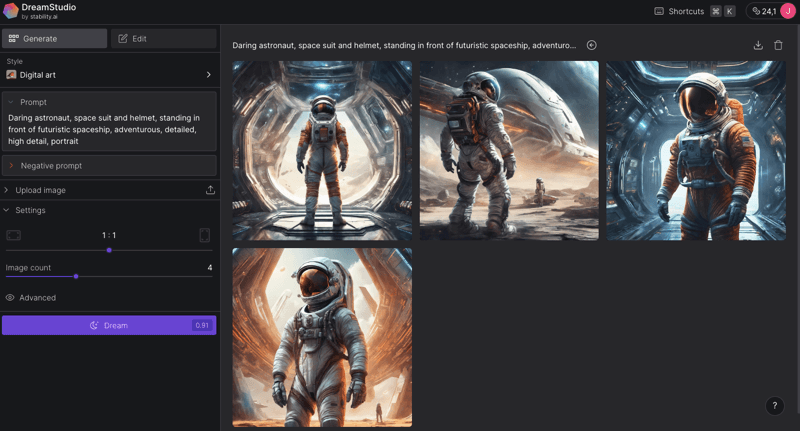

Zunächst müssen Sie auf die zugreifen Stable Diffusion Modell. Dies kann über die Web-Benutzeroberfläche oder durch lokales Einrichten des Modells auf Ihrem Computer erfolgen. Besuchen Sie zunächst die offizielle Website oder eine Community-gesteuerte Plattform (Clipdrop, DreamStudio or Hugging Face), das die SD-WebUI hostet, und folgen Sie dann den bereitgestellten Anweisungen, um die Schnittstelle zu starten.

Hier werden wir nehmen DreamStudio als Beispiel, um Ihnen zu zeigen, wie Sie ein Bild erstellen Stable Diffusion.

Schritt 2: Erstellen Sie Ihre Eingabeaufforderung

Die Qualität Ihres KI-generierten Bildes hängt weitgehend von der von Ihnen bereitgestellten Eingabeaufforderung ab. Eine gut gestaltete Eingabeaufforderung sollte klar, beschreibend und so spezifisch wie möglich sein. Denken Sie über das Bild nach, das Sie erstellen möchten, und schreiben Sie eine Aufforderung, die Details wie Thema, Stil, Farben und Stimmung enthält. Und Sie können auch künstlerische oder technische Begriffe verwenden, wenn Sie eine klare Vorstellung von dem Stil haben, den Sie anstreben.

Schritt 3: Generieren Sie Ihr Bild

Sobald Sie Ihre Eingabeaufforderung fertig haben, ist es Zeit, Ihr Bild zu generieren. Fügen Sie nun Ihre Eingabeaufforderung in das dafür vorgesehene Textfeld in der SD-WebUI ein. Passen Sie alle zusätzlichen Einstellungen an, z. B. Seed (zur Zufallssteuerung), Schritte (zur Bildverfeinerung) und Stil (sofern die Schnittstelle Optionen bereitstellt). Klicken Sie auf die Schaltfläche „Generieren“, um den Bilderstellungsprozess zu starten.

Schritt 4: Überprüfen und Verfeinern

Nachdem die KI Ihre Eingabeaufforderung verarbeitet hat, wird Ihnen eine Vorschau des generierten Bildes angezeigt. Bewerten Sie das Bild anhand Ihrer ursprünglichen Vision. Wenn das Bild nicht Ihren Erwartungen entspricht, verfeinern Sie Ihre Eingabeaufforderung oder passen Sie die Einstellungen an. Erstellen Sie das Bild neu, bis Sie mit dem Ergebnis zufrieden sind.

Schritt 5: Herunterladen und Verwenden Ihres AI-Bildes

Sobald Sie mit einem Bild zufrieden sind, können Sie es herunterladen, um es in Ihren Projekten zu verwenden. Klicken Sie auf die Schaltfläche „Herunterladen“, um das Bild auf Ihrem Gerät zu speichern. Verwenden Sie das Bild in Ihren kreativen Projekten und stellen Sie sicher, dass Sie über etwaige Lizenz- oder Nutzungsbeschränkungen informiert sind.

Schritt 6: Erkunden erweiterter Funktionen (optional)

Wenn Sie sich damit wohler fühlen Stable DiffusionErwägen Sie die Erkundung erweiterter Funktionen:

- Experimentieren Sie mit verschiedenen Stilen, zum Beispiel Vintage oder Futuristisch.

- Verwenden Sie das Plugin „UpScale“ für Bilder mit höherer Auflösung.

- Probieren Sie „ControlNet“ aus, um die Bildelemente präziser steuern zu können.

4 Schritte zum Erstellen konsistenter Charaktere in Stable Diffusion

Erschaffen konsistenter imaginärer Charaktere mit Stable Diffusion erfordert eine sorgfältige Feinabstimmung des Modells, um es an Ihre spezifische kreative Vision anzupassen. Durch Befolgen dieser Schlüsseltechniken können Sie ein hohes Maß an Konsistenz bei der Charaktererstellung erreichen und sicherstellen, dass jede Iteration Ihrem ursprünglichen Konzept treu bleibt.

Schritt 1: Erstellen Sie ein Referenzbild

Der erste Schritt besteht darin, ein Referenzbild zu entwickeln, das Ihren Charakter visuell darstellt. Dieses Bild kann ein Originalkunstwerk, ein Auftragswerk oder ein KI-generiertes Bild sein.

Ein Referenzbild dient als visuelle Anleitung für Stable Diffusion. Indem Sie dieses Bild zusammen mit Ihren zukünftigen Eingabeaufforderungen bereitstellen, haben Sie für das Modell ein klares Vorbild, das es nachahmen kann, und können so besser verstehen, wie die Figur aussehen soll.

Tipps für ein gutes Referenzbild:

- Vollständige Zeichenanzeige: Stellen Sie sicher, dass das Bild den vollständigen Charakter mit klaren und detaillierten Merkmalen zeigt.

- Hochauflösende Qualität: Verwenden Sie hochauflösende Bilder, um komplizierte Details festzuhalten.

- Einzigartige Attribute: Fügen Sie besondere Merkmale wie Kleidung, Waffen und Accessoires hinzu.

- Persönlichkeit und Emotion: Erfassen Sie die Persönlichkeit und den emotionalen Ausdruck der Figur.

Schritt 2: Details zur Eingabeaufforderung hinzufügen

Die Texteingabe ist entscheidend für die Steuerung Stable Diffusion's Ausgabe. Für eine konsistente Zeichengenerierung müssen Ihre Eingabeaufforderungen außergewöhnlich detailliert und spezifisch sein.

Geben Sie Details an wie:

- Charaktername

- Geschlecht

- Physikalische Eigenschaften: Gesichtsform, Hautfarbe, Größe, Körperbau usw.

- Frisur und Farbe

- Outfitbeschreibungen: Farben, Materialien, Rüstung und andere Besonderheiten.

- Persönlichkeitsmerkmale

- Einstellungs-/Szenendeskriptoren

Die Angabe eindeutiger und spezifischer Details stellt sicher, dass Stable Diffusion generiert konsistente Darstellungen Ihres Charakters. Die Wiederverwendung derselben Deskriptoren in jeder Eingabeaufforderung hilft dabei, die Übereinstimmung zwischen verschiedenen Bildern beizubehalten.

Schritt 3: Kontrollnetze verwenden

Kontrollnetze sind ein mächtiges Werkzeug zur Steuerung des Diffusionsprozesses während der Zeichengenerierung. Sie vergleichen die Ergebnisse von Stable Diffusion zu Ihrem Referenzbild und passen Sie die Gewichte an, wenn die Ausgaben zu weit von der Referenz abweichen.

Sie können auf Plattformen wie Automatic1111 aus Ihrem Zeichenreferenzbild ein Kontrollnetz erstellen und es beim Generieren neuer Bilder anwenden.

Kontrollnetze funktionieren wie Zügel und lenken Stable Diffusion's kreativer Prozess, um Ihrem ursprünglichen Charakterkonzept treu zu bleiben.

Schritt 4: Experimentieren Sie mit verschiedenen Einstellungen

Stable Diffusion bietet verschiedene Einstellungen, mit denen Sie die Zeichenkonsistenz verbessern können:

- Samen Nummer: Der Seed bestimmt das Startgeräusch. Die Verwendung desselben Seeds mit derselben Eingabeaufforderung führt zur gleichen Ausgabe, was für die Wahrung der Konsistenz entscheidend ist.

- Schritte: Höhere Schritte bieten mehr Diffusionszeit, damit Details hervortreten können. Experimentieren Sie mit Schrittzahlen zwischen 50 und 100.

- Probenahmeverfahren: „Euler a“ ist optimal für scharfe Details, während „Euler“ weicher ist und helfen kann, wenn Bilder verzerrt erscheinen.

- CFG-Skala: Passen Sie diesen Wert vom Standardwert 7.5 an, um die Bildkohärenz zu ändern.

- Größe Größere Bildgrößen, beispielsweise 512 × 512 oder höher, sind vorzuziehen, da bei kleineren Größen wichtige Zeichendetails verloren gehen können.

Nehmen Sie sich die Zeit, um zu untersuchen, wie sich unterschiedliche Einstellungen auf Ihre generierten Charaktere auswirken. Wenn Sie die richtige Balance zwischen diesen Einstellungen finden, wird die Charakterkonsistenz erheblich verbessert.

Fazit

Halten Sie Ausschau nach dem nächsten Teil dieser Serie, in dem wir Sie durch den Bereitstellungsprozess von führen Stable Diffusion und geben Sie wertvolle Tipps und Tricks weiter, um Ihre KI-generierte Kunstreise zu verbessern.